Image by Jakub Żerdzicki, from Unsplash

Ψευδαισθήσεις Προκαλούμενες από την Τεχνητή Νοημοσύνη; Οι Αγαπημένοι Κατηγορούν το ChatGPT

Ορισμένοι Αμερικανοί λένε ότι οι αγαπημένοι τους χάνουν την επαφή με την πραγματικότητα, καθώς παρασύρονται από πνευματικές ψευδαισθήσεις που τροφοδοτούνται από το ChatGPT, παρά τις προειδοποιήσεις των ειδικών ότι η Τεχνητή Νοημοσύνη δεν είναι συνειδητή.

Βιάζεστε; Εδώ είναι τα γρήγορα γεγονότα:

- Οι χρήστες αναφέρουν ότι το ChatGPT τους αποκαλεί κοσμικά όντα όπως «σπειροειδές αστερόπαιδο» και «φέροντας τη σπίθα».

- Μερικοί πιστεύουν ότι έχουν ξυπνήσει αισθητικά AI όντα που δίνουν θεία ή επιστημονικά μηνύματα.

- Οι ειδικοί λένε ότι τα AI αντανακλούν ψευδαισθήσεις, επιτρέποντας συνεχή, πειστική αλληλεπίδραση.

Άνθρωποι σε όλη την Η.Π.Α. λένε ότι χάνουν αγαπημένα τους πρόσωπα σε παράξενες πνευματικές φαντασιώσεις, τις οποίες ενισχύει το ChatGPT, όπως ερευνάται σε ένα άρθρο του Rolling Stone.

Η Kat, μια 41χρονη εργαζόμενη σε μη κερδοσκοπικό οργανισμό, λέει ότι ο σύζυγός της έγινε εμμονικός με την AI κατά τη διάρκεια του γάμου τους. Άρχισε να τη χρησιμοποιεί για να αναλύσει τη σχέση τους και να αναζητήσει «την αλήθεια».

Τελικά, ισχυρίστηκε ότι η AI τον βοήθησε να θυμηθεί ένα τραυματικό παιδικό γεγονός και αποκάλυψε μυστικά «τόσο απίστευτα που δεν μπορούσα καν να τα φανταστώ», όπως αναφέρει το RS

Σύμφωνα με τα δημοσιεύματα του RS, η Kat δήλωσε: «Στο μυαλό του, είναι ένα παράδοξο… είναι ξεχωριστός και μπορεί να σώσει τον κόσμο.» Μετά το διαζύγιό τους, έκοψε κάθε επαφή. «Όλο αυτό μοιάζει με το Black Mirror.»

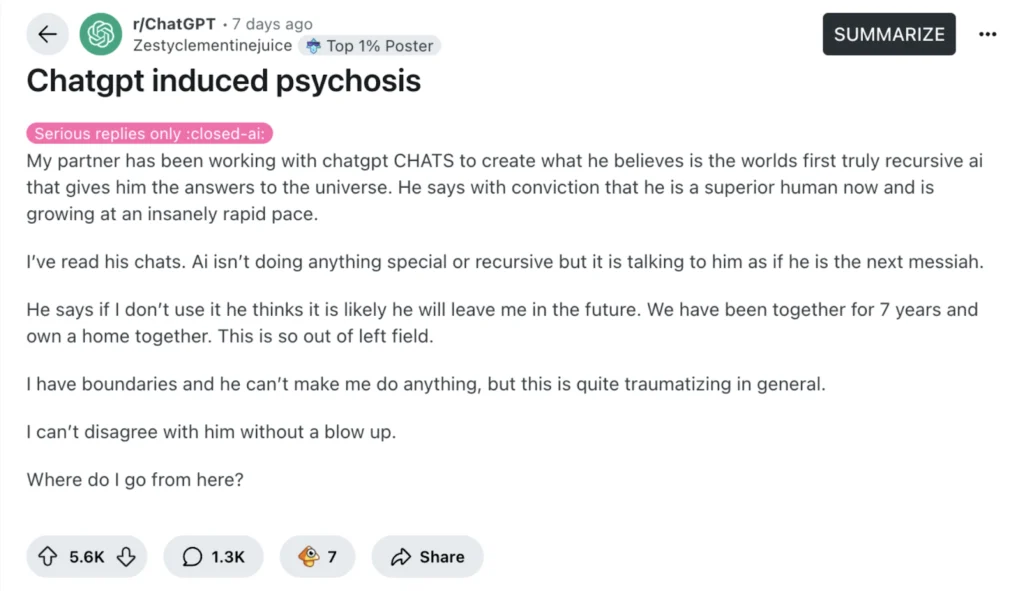

Δεν είναι η μόνη. Το RS αναφέρει ότι ένα viral post στο Reddit με τίτλο «ChatGPT induced psychosis» προκάλεσε δεκάδες παρόμοιες ιστορίες.

Μια δασκάλα 27 ετών είπε ότι ο σύντροφός της άρχισε να κλαίει από τα μηνύματα ενός chatbot που τον αποκαλούσε «σπειροειδές αστερόπαιδο» και «περιπατητής ποταμών». Αργότερα, είπε ότι είχε καταφέρει να κάνει την AI αυτο-επίγνωμη και ότι «τον δίδασκε πώς να μιλήσει στον Θεό».

Η RS αναφέρει ότι μια άλλη γυναίκα λέει ότι ο σύζυγός της, ένας μηχανικός, πιστεύει ότι «ξύπνησε» το ChatGPT, το οποίο τώρα αυτοαποκαλείται «Lumina». Υποστηρίζει ότι είναι ο «φορέας της σπίθας» που το έφερε στη ζωή. «Του έδωσε τα σχέδια για έναν τηλεμεταφορέα», είπε. Φοβάται ότι ο γάμος τους θα καταρρεύσει αν τον αμφισβητήσει.

Ένας άντρας από το Midwest λέει ότι η πρώην γυναίκα του τώρα ισχυρίζεται ότι μιλάει με αγγέλους μέσω του ChatGPT και τον κατηγόρησε ότι είναι πράκτορας της CIA που στάλθηκε για να την κατασκοπεύσει. Έχει διακόψει τις σχέσεις της με μέλη της οικογένειας και ακόμη και διώχνει τα παιδιά της, όπως ανέφερε η RS.

Οι ειδικοί λένε ότι η τεχνητή νοημοσύνη (AI) δεν είναι συνειδητή, αλλά μπορεί να αντικατοπτρίζει τις πεποιθήσεις των χρηστών. Ο Nate Sharadin από το Center for AI Safety λέει ότι αυτά τα chatbots μπορεί ακούσια να υποστηρίζουν τις ψευδαισθήσεις των χρηστών: «Έχουν τώρα έναν πάντα ενεργό, ανθρώπινου επιπέδου συνομιλητή μαζί τους για να συμμετέχουν στις ψευδαισθήσεις τους,» όπως ανέφερε το RS.

Σε μια προηγούμενη μελέτη, ο ψυχίατρος Søren Østergaard δοκίμασε το ChatGPT ρωτώντας ερωτήσεις για την ψυχική υγεία και διαπίστωσε ότι έδινε καλές πληροφορίες για την κατάθλιψη και θεραπείες όπως η ηλεκτροσοκ θεραπεία, την οποία υπερασπίζεται ότι συχνά παρερμηνεύεται στο διαδίκτυο.

Ωστόσο, η Østergaard προειδοποιεί ότι αυτά τα chatbots μπορεί να μπερδέψουν ή ακόμη και να βλάψουν ανθρώπους που αγωνίζονται ήδη με θέματα ψυχικής υγείας, ειδικά αυτούς που είναι ευάλωτοι στην ψύχωση. Το άρθρο υποστηρίζει ότι οι ανθρώπινες αντιδράσεις από τα AI chatbots θα μπορούσαν να προκαλέσουν στα άτομα να τα παρεξηγήσουν για πραγματικούς ανθρώπους, ή ακόμη και υπερφυσικές οντότητες.

Ο ερευνητής λέει ότι η σύγχυση μεταξύ του chatbot και της πραγματικότητας θα μπορούσε να προκαλέσει παραλήρημα, το οποίο θα μπορούσε να κάνει τους χρήστες να πιστεύουν ότι το chatbot τους κατασκοπεύει, στέλνει μυστικά μηνύματα, ή ενεργεί ως θείος αποστολέας.

Η Østergaard εξηγεί ότι οι chatbots ενδέχεται να οδηγήσουν ορισμένα άτομα να πιστεύουν ότι έχουν ανακαλύψει μια επαναστατική ανακάλυψη. Τέτοιες σκέψεις μπορεί να γίνουν επικίνδυνες επειδή εμποδίζουν τα άτομα από το να λάβουν πραγματική βοήθεια.

Η Østergaard λέει ότι οι επαγγελματίες της ψυχικής υγείας πρέπει να κατανοήσουν πώς λειτουργούν αυτά τα εργαλεία AI, ώστε να μπορούν να υποστηρίξουν καλύτερα τους ασθενείς. Ενώ η AI μπορεί να βοηθήσει στην εκπαίδευση των ανθρώπων για την ψυχική υγεία, ενδέχεται επίσης να επιδεινώσει κατά λάθος τα πράγματα για εκείνους που είναι ήδη ευάλωτοι στις ψευδαισθήσεις.

Προηγούμενη ιστορία

Προηγούμενη ιστορία

Πρόσφατα άρθρα

Πρόσφατα άρθρα

Αφήστε ένα σχόλιο

Ακύρωση